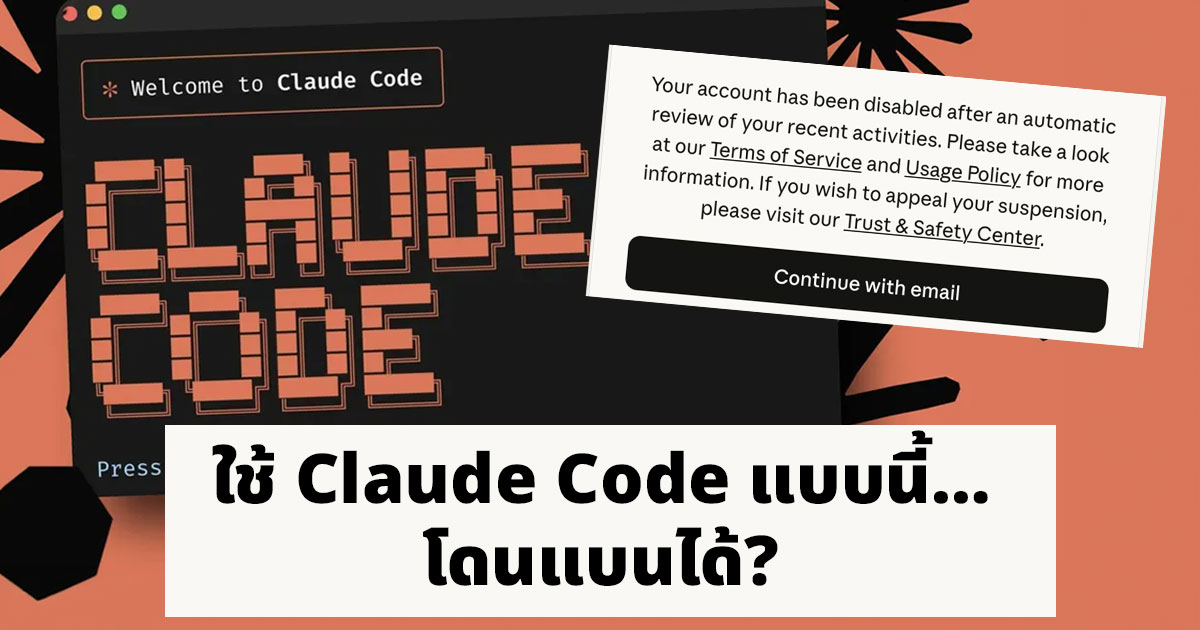

เรื่องนี้น่าสนใจไปอ่านเจอใน reddit มาว่า มีคนนึงโดน Anthropic แบน เพราะวิธีใช้ Claude Code

ผมคิดว่าสิ่งที่เค้าทำ หลายคนก็ทำแบบนี้ รวมถึงตัวผมเองด้วย (แค่ยังไม่โดนแบน)

ก็เลยเอามาเล่าให้ฟังกันเล่นๆ

คนเขียนเล่าว่า เค้าใช้ Claude Max pro ราคา $200 อยู่มาวันนึงเจอ error 400

API Error: 400

“This organization has been disabled.”

และเค้าอธิบายว่าก่อนโดนแบน ว่าเค้าทำอะไร สิ่งที่เค้าทำ คือ

ทำ loop Claude A และ Claude B เปิด 2 ตัวช่วยกันทำงาน

Claude A:

รันอยู่ Terminal 1 ทำหน้าที่ ปรับปรุง scaffold tool + CLAUDE.md

Claude B:

รันอยู่ Terminal 2 ทำหน้าที่เขียน code ปกติ

ซึ่งไฟล์สำคัญใน workflow นี้คือ CLAUDE.md ที่เอาไว้ให้ Claude code อ่าน workflow ที่เค้าใช้มีประมาณนี้

Claude A: ช่วยเขียน scaffold tool + CLAUDE.md

Claude B: ใช้ scaffold เพื่อสร้าง project และเขียน code

ถ้า Claude B ทำงานผิด เค้าจะเอา error กลับไปบอก Claude A

Claude A จะปรับปรุง CLAUDE.md ให้ AI เข้าใจดีขึ้น และสร้าง project ใหม่เพื่อทดสอบอีกครั้ง และวนลูปแบบนี้ไปเรื่อย ๆ จนกว่าจะผ่าน

—-

scaffold tool คือ tool ที่ใช้ gen project structure

สร้าง folder, config และ template code

เช่น เมื่อเราสั่งปุ๊ป จะสร้างไฟล์ตามโครงสร้างไว้ทันทีใน 1 คำสั่ง

—-

แต่! เจ้าของเรื่องเค้าบอกว่า เค้าสังเกตได้อย่างนีง เมื่อ Claude A เห็น error ที่ Claude B ทำผิดบ่อยๆ มันเขียน comment ให้ Claude B ด้วยพิมพ์ใหญ่ทั้งหมด !! ดูแล้วเหมือน Claude A กำลังหงุดหงิด Claude B

เค้าเลยคิดว่า นั้นอาจไปกระตุ้น ระบบตรวจจับ prompt injection

ของ Anthropic จนทำให้ถูกแบน!?

แต่เค้าบอกว่านี่คือ “ข้อสันนิษฐานส่วนตัว”

และหลายๆ คนที่อยู่ในเว็บ Hacker News ก็มีความคิดตรงกันว่า

คำสั่งที่เป็น all-caps และมีลักษณะกำกับพฤติกรรมโมเดลแรง ๆ

อาจดูเหมือน prompt hijacking / jailbreak pattern ได้

เรื่องนี้ยังไม่มีบทสรุปที่ชัดเจน

ทั้งหมดนี้ไม่ได้ถูกยืนยันจาก Anthropic ว่าที่แบนๆ เพราะอะไร

Anthropic ไม่ได้บอกว่าแบนเพราะ all-caps ใน CLAUDE.md

Anthropic ไม่ได้ออกมาชี้แจงอะไร

Anthropic คืนเงินค่า subscription 100%

— ความเห็นส่วนตัว —

มองเชิงเทคนิค การใช้ LLM ความเสี่ยงของ prompt injection

มักเกี่ยวกับข้อความที่ ใช้น้ำเสียงบังคับสูงมาก, พยายาม override กฎเดิม

พยายามเปลี่ยนพฤติกรรม agent อย่างเป็นระบบ

ดังนั้น ถ้า CLAUDE.md ที่ถูกสร้างเริ่มเต็มไปด้วยคำสั่งตัวใหญ่ล้วน แบบ

“DO NOT… ALWAYS… NEVER…” เยอะ ๆ

ระบบอัตโนมัติอาจมองว่าเสี่ยง

แม้เจตนาจริงจะเป็นแค่การกำชับ workflow ก็ตาม

จริงๆ เรื่องนี้น่าสนใจ เพราะเกี่ยวกับ flow

AI agent self-improving prompt loop หรือ

AI improving instructions for another AI

และผมคิดว่าการทำงานแบบนี้มันธรรมดามาก

ซึ่งเป็นกระบวนการปกติที่ dev ทั่วไปควรทำ

code > review > fix bug > review > fix again

และคิดว่าหลายคนกำลังใช้วิธีนี้อยู่

ซึ่งถ้าทำแบบนี้แล้วมันผิด policy จริง

ผู้ให้บริการควรออกมาบอกก่อนมั้ย?

—–

edit update:

Anthropic กำลัง crack down เรื่อง third-party harness ใช้ subscription ทำ automated loop แบบ flat-rate (subscription arbitrage) และ เจ้าของโพสอาจโดน ban เป็น collateral damage ไม่ใช่แค่เรื่อง ALL CAPS อย่างเดียว

—–